自分用の覚え書きです。

タグ: OpenCV

3/26メモ

heroku わかりやすい。 Heroku入門 (全12回) – プログラミングならドットインストール heroku 上で Rails アプリが動くところまでざっと見てみました。てか、heroku の前にまと…

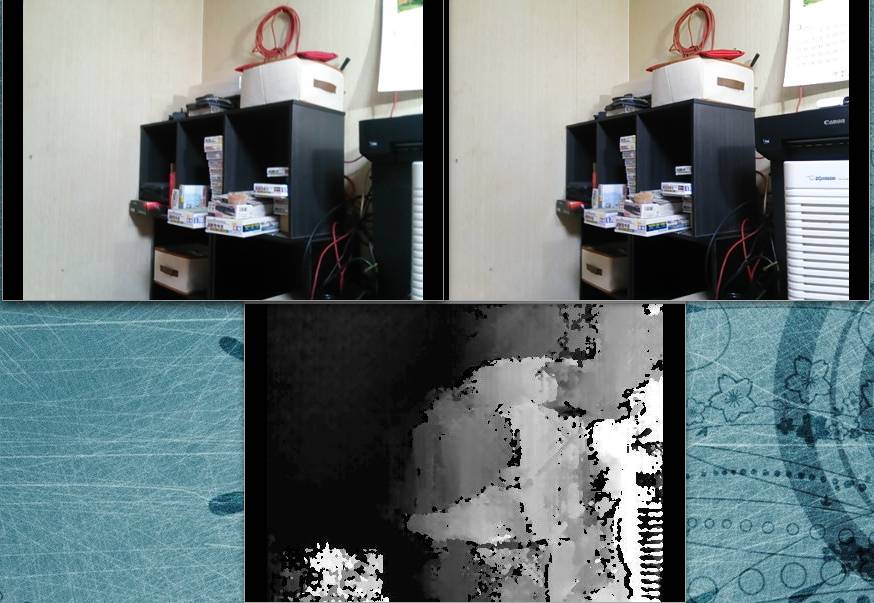

OpenCVでステレオマッチング(ステレオカメラ)

前日より引き続き、OpenCV でステレオ画像による深度計算をやっています。 昨晩、スマホの単眼カメラで撮影した2枚のステレオ画像の深度計算で割と良さそうな結果が出たので、Amazonで安いWebカメラを二つ注文。早速届…

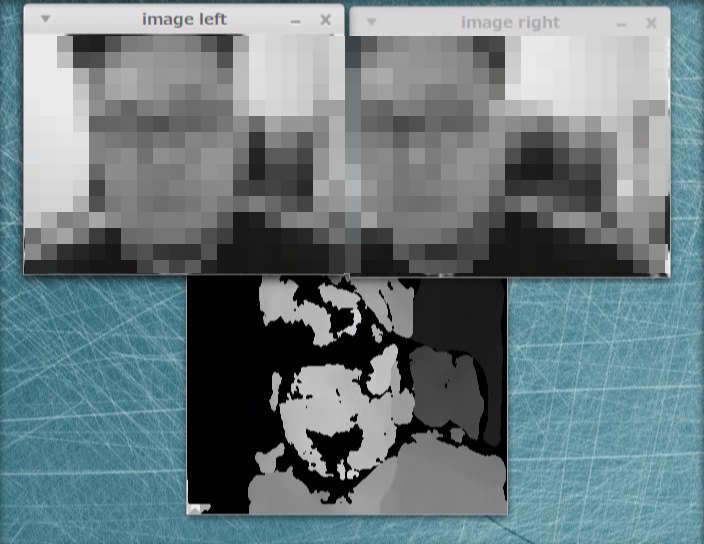

OpenCVでステレオマッチング

かなりの今更感はさておき、OpenCV でステレオ画像による深度計算をやっています。 環境 LMDE2 64bit OpenCV2 Python2.7 スクリプト 入力画像と深度計算の結果 cv2.StereoSGBM(…

Ruby と OpenCV でカメラを使う

前回に引き続き、ruby-opencv でカメラデバイスをソースにしてリアルタイム検知をやってみたいと思います。 使っているカメラ Microsoft 社製の USB 接続 HD ウェブカムです。エンドユーザ向けにしては…

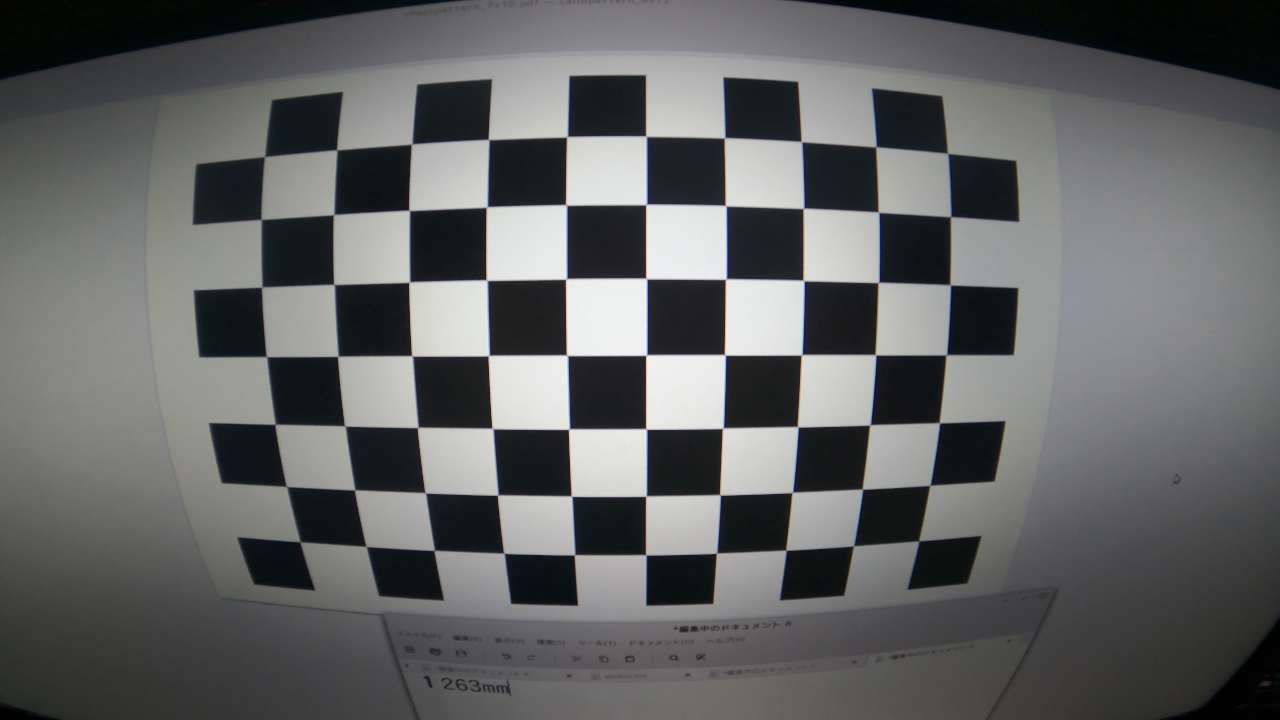

Ruby と OpenCV でチェッカーボード検知

前日に引き続き、ruby-opencv でチェッカーボードを認識させてみたいと思います。チェッカーボードとは市松模様のパターンのことで、これを認識することにより映像中の3次元座標系(の行列)を確定させることができ、映像の…

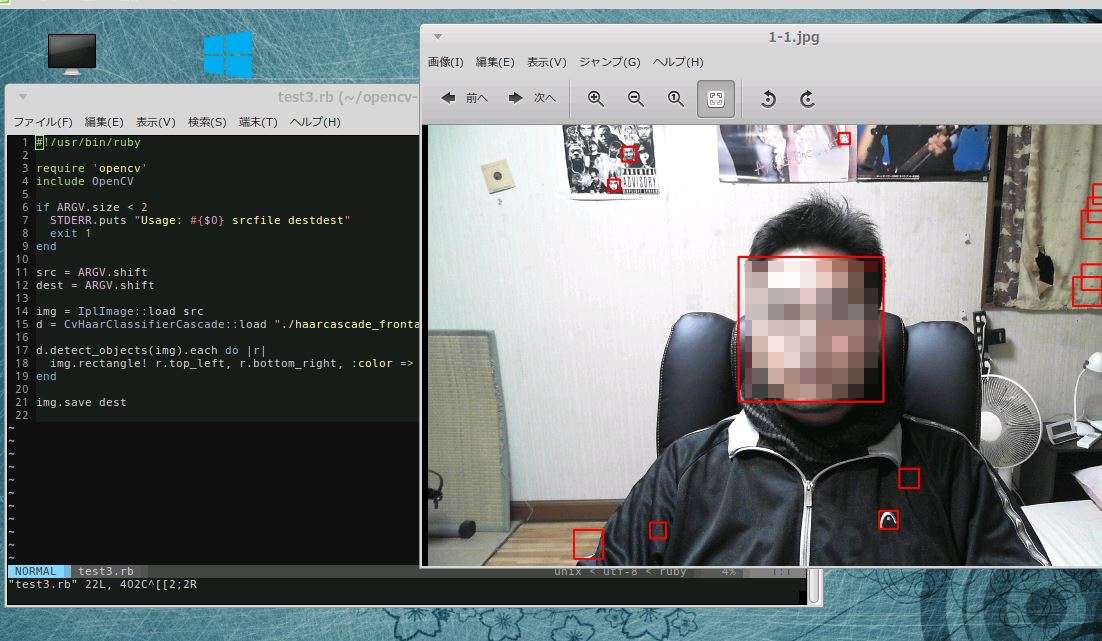

Ruby と OpenCV で顔認識

去年の秋に組んだ新しいメインマシンは、MSI のB150M MORTAR ARCTIC (MS-7A45) という新しいマザボで、LMDE2 x64 を乗せて使おうとすると USB デバイスまわりが突然使用不能になったり…