Amazon Lightsail で Rails on Ruby の環境を構築するための自分用メモです。 環境 Amazon Lightsail (AWS) Debian GNU/LInux 10.8 x86_64

タグ: Ruby

変数値を範囲内に丸める

整数値を持つ変数 x を min 〜 max で定義される範囲内に丸めたいというお話。

3/26メモ

heroku わかりやすい。 Heroku入門 (全12回) – プログラミングならドットインストール heroku 上で Rails アプリが動くところまでざっと見てみました。てか、heroku の前にまと…

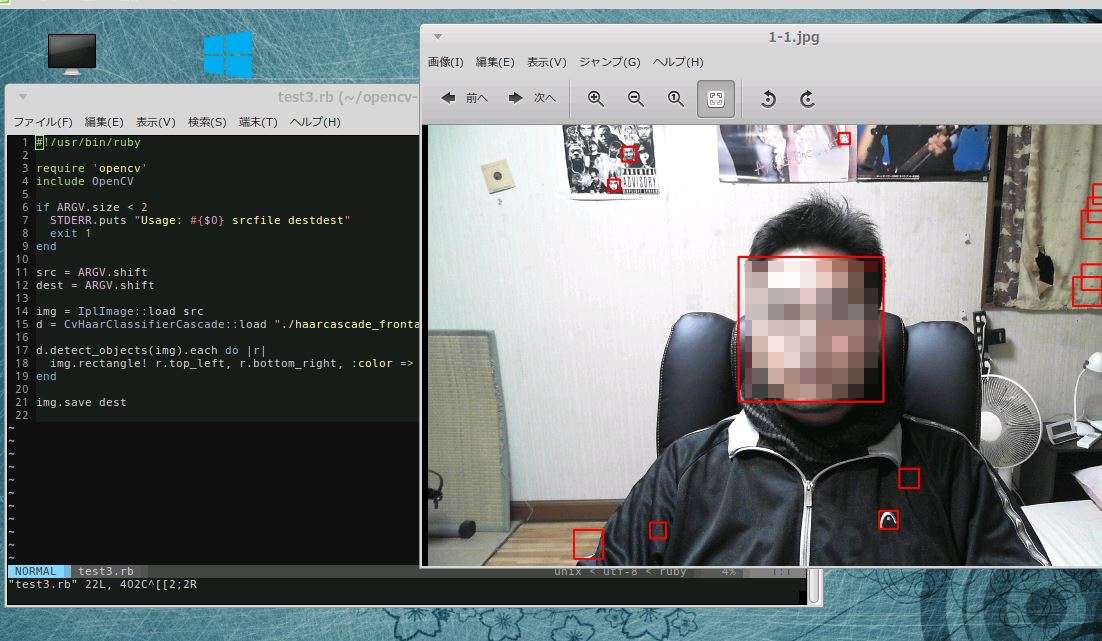

Ruby と OpenCV でカメラを使う

前回に引き続き、ruby-opencv でカメラデバイスをソースにしてリアルタイム検知をやってみたいと思います。 使っているカメラ Microsoft 社製の USB 接続 HD ウェブカムです。エンドユーザ向けにしては…

Ruby と OpenCV でチェッカーボード検知

前日に引き続き、ruby-opencv でチェッカーボードを認識させてみたいと思います。チェッカーボードとは市松模様のパターンのことで、これを認識することにより映像中の3次元座標系(の行列)を確定させることができ、映像の…

Ruby と OpenCV で顔認識

去年の秋に組んだ新しいメインマシンは、MSI のB150M MORTAR ARCTIC (MS-7A45) という新しいマザボで、LMDE2 x64 を乗せて使おうとすると USB デバイスまわりが突然使用不能になったり…

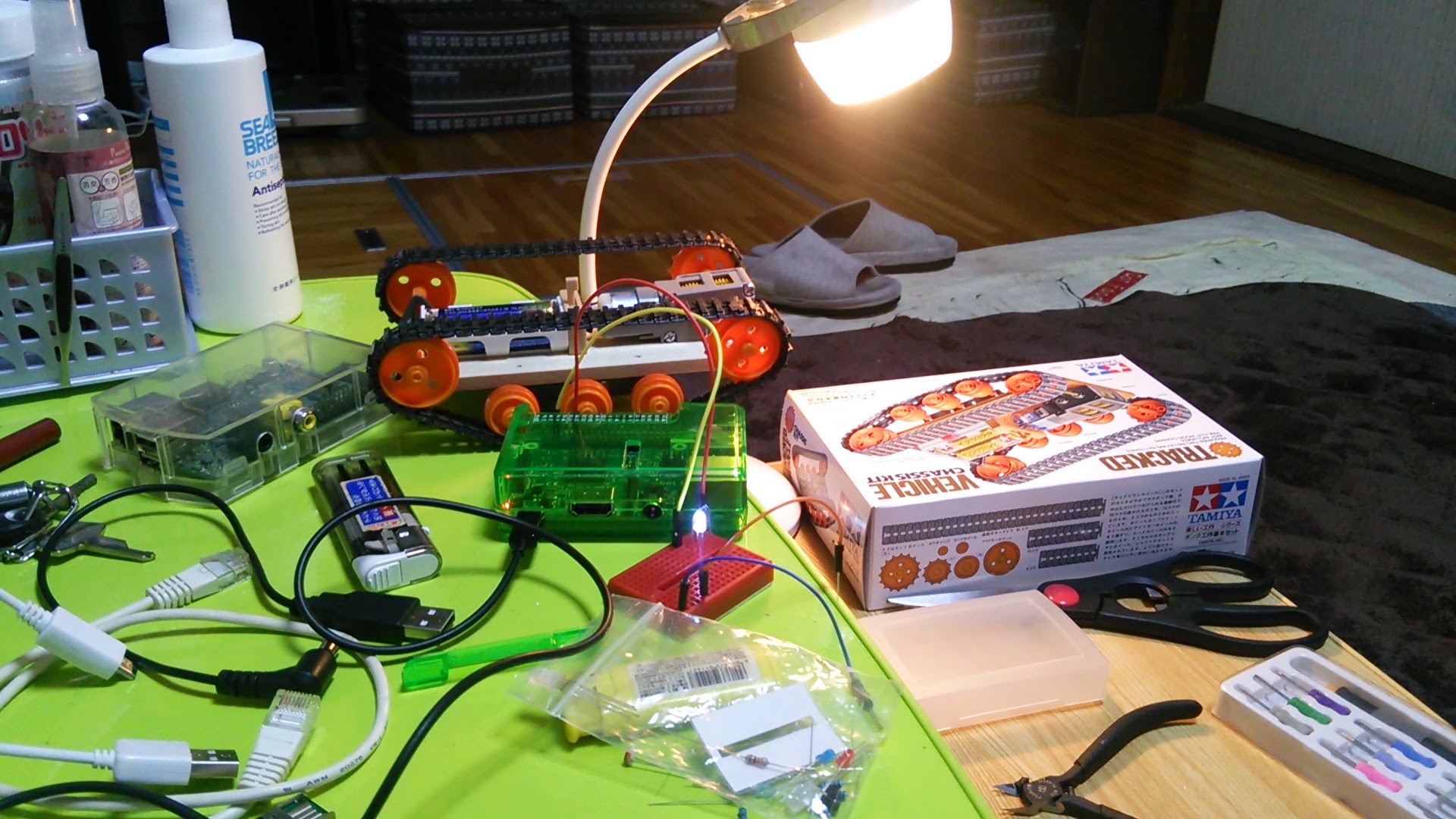

Raspberry Pi 3 で mruby を動かす

Raspberry Pi 3 が届きました! 発売より半年ほど出遅れましたが、ようやく Raspberry Pi 3 Model B を購入したので、組み込み向け軽量 Ruby である mruby を動かしていきたいと思…

マルコフ連鎖を使って文章の自動生成を行う

割と古典ですが、マルコフ連鎖の考え方を用いて、自動生成するスクリプトを書いてみました。入力した文章の単語同士の結合情報を重みづけをして「それっぽい文章」を生成してくれるやつです。以前からよく人工無能などでの実装で使われて…

括弧を省略したLispコードのプロセッサーを書いてみました。

supoo(旧実装) これまで業務でも趣味でも Lisp をガリガリ書くということはなく、せいぜい Emacs の設定ファイルを書くことにしか使ったことがありませんでした。 構文は非常にシンプルで、「これなら字句解析も構…

アスペクト比と面積から縦横の大きさを求めるRubyスクリプト

ImageMagick の montage コマンドを使うと複数の画像をタイル状に並べて、1枚のサムネイル集合写真のような画像を作成することができます。スマートフォンの「カメラロール」のようなものです。 具体的には次のよ…